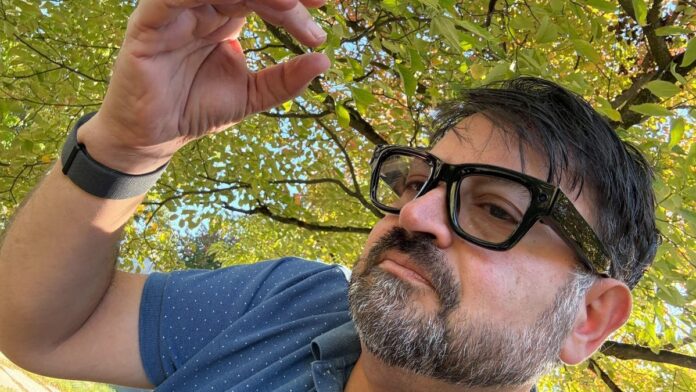

Les lunettes intelligentes Ray-Ban de Meta allient commodité et IA de pointe, mais les questions concernant la confidentialité des données restent une préoccupation majeure pour les utilisateurs. Malgré les déclarations officielles de l’entreprise, l’ambiguïté autour de l’accès aux données de tiers et de l’utilisation des services d’IA suscite des inquiétudes légitimes.

Le problème principal : l’accès des tiers aux données des utilisateurs

Des rapports récents ont révélé que les sous-traitants de Meta au Kenya avaient accès aux données sensibles des utilisateurs enregistrées à travers les lunettes, notamment les relevés bancaires, les images de nus et les rencontres privées. Cela a conduit à un recours collectif et à un examen minutieux des politiques de confidentialité de Meta.

Le problème principal n’est pas seulement si des tiers consultent les données, mais quand et dans quelles circonstances. Meta confirme que les sous-traitants examinent parfois le contenu généré par les utilisateurs lorsque les services d’IA sont utilisés, apparemment à des fins de formation et de contrôle qualité. Cependant, les limites entre les fonctionnalités assistées par l’IA et l’enregistrement standard restent floues.

Explication de Meta : Un manque de transparence

Meta insiste sur le fait que les données partagées avec les services d’IA peuvent être examinées par des sous-traitants, tandis que les enregistrements non-IA restent privés. L’entreprise prétend filtrer les informations sensibles pour empêcher toute identification, mais le scandale des entrepreneurs kenyans jette le doute sur ces assurances.

Le langage utilisé par Meta est vague : « politiques et garde-fous stricts » et « étapes pour filtrer les données » offrent peu de détails concrets. Les utilisateurs font confiance à une entreprise ayant des antécédents de faux pas en matière de confidentialité, y compris le scandale Cambridge Analytica, qui souligne le risque inhérent.

Stockage cloud et médias connectés à l’IA

Les lunettes Meta offrent une fonctionnalité « Cloud Media » pour le traitement et le stockage temporaire, permettant les commandes vocales et l’importation automatique de médias. Même si Meta affirme que les photos et vidéos téléchargées via cette fonctionnalité ne sont pas soumises à des annotations humaines, le manque de définitions claires autour du « Cloud Media » crée une incertitude.

La distinction entre les données « privées » et « connectées à l’IA » est floue, exposant potentiellement les contenus sensibles à un examen par des tiers. La désactivation de Cloud Media conserve les données locales mais sacrifie la commodité, obligeant les utilisateurs à choisir entre confidentialité et fonctionnalité.

Vue d’ensemble : un avenir pour la surveillance par IA portable ?

Les lunettes Ray-Ban de Meta se sont vendues à plus de 7 millions d’unités, ouvrant la voie à une vague de dispositifs portables dotés d’une caméra et dotés d’une IA. Google et d’autres sociétés entrent sur le marché, intensifiant ainsi les préoccupations en matière de confidentialité. À mesure que les lunettes IA deviennent omniprésentes, le besoin de transparence et de contrôle des utilisateurs devient critique.

L’industrie doit répondre aux questions liées à la reconnaissance faciale, au stockage des données et à l’accès de tiers avant que ces appareils ne soient pleinement intégrés dans la vie quotidienne. Sans politiques et garanties claires, les utilisateurs risquent de renoncer à leur vie privée pour des raisons de commodité.

En fin de compte, les lunettes intelligentes de Meta offrent une expérience technologique convaincante mais nécessitent un examen attentif des risques associés en matière de confidentialité. Le manque de transparence dans le traitement des données rend difficile pour les utilisateurs de faire pleinement confiance au système. Jusqu’à ce que des garanties plus claires soient mises en œuvre, la prudence est de mise lors de l’utilisation de ces appareils pour des activités sensibles.